Intelligence artificielle et discriminations

1. Qu'est-ce que l'intelligence artificielle ?

L’expression « intelligence artificielle », créée dans les années 1950, désigne le domaine de recherche qui étudie les mécanismes de l’intelligence artificielle : création d’algorithme, de machine pouvant les exploiter et de base de données pour entrainer et valider l’ensemble. Ces mécanismes incluent par exemple la faculté de trouver automatiquement des solutions à des problèmes, peut mettre en œuvre des capacités de planification, de prédiction, de contrôle, de mémorisation ou d’apprentissage. Par extension, le terme « intelligence artificielle » est souvent utilisé pour "désigner des algorithmes simulant ou ayant des points communs avec certaines des capacités d’intelligences des êtres vivants.” (source : Pierre-Yves Oudeyer et Didier Roy d’Inria)

Ainsi, l'intelligence artificielle (IA) peut-être décrite comme la science visant à rendre les machines intelligentes. Pour la CNIL, L’intelligence artificielle est un procédé logique et automatisé reposant généralement sur un algorithme en mesure de réaliser des tâches bien définies par l'être humain. Cela signifie que les machines utilisant l'IA sont capables (avec certaines limites quand même), d'imiter le comportement humain ou l'intelligence humaine dans le but de nous aider à automatiser des tâches, prendre des décisions et analyser des données le plus rapidement possible.

Pour qu'une intelligence artificielle puissent être fonctionnelle, il faut l'alimenter avec un grand nombre de données et l'entrainer à les traiter, les analyser ; ce n'est qu'après ces étapes de récolte et d'analyse que ces dernières pourront être en capacité d'utiliser les données pour prendre des décisions "éclairées" et répondre à nos demandes. Néanmoins l'intelligence artificielle est un concept vaste est difficile à définir précisément en raison de sa nature étendu et en perpétuelle évolution.

Pour accomplir les tâches que nous lui demandons, l'IA utilise différentes techniques, dont quatre formes d'apprentissages :

Apprentissage supervisé

Procédé d’apprentissage automatique dans lequel l’algorithme s’entraîne à une tâche déterminée en utilisant un jeu de données assorties chacune d’une annotation indiquant le résultat attendu.

Exemple:

-> Classification d'email en "spam" ou "non-spam"

-> Classification d'images représentant un chat ou un chien

Apprentissage non supervisé

Procédé d’apprentissage automatique dans lequel l’algorithme utilise un jeu de données brutes et obtient un résultat en se fondant sur la détection de similarités entre certaines de ces données.

Exemple : Proposer des produits similaires à ceux déjà achetés par les utilisateurs en analysant simplement leur donnée non étiquetée.

Apprentissage profond (deep learning)

Procédé d’apprentissage automatique utilisant des réseaux de neurones possédants plusieurs couches de neurones cachées. Ces algorithmes possédant de très nombreux paramètres demandent un nombre très important de données afin d’être entraînés. Le système apprendra par exemple à reconnaître les lettres avant de s'attaquer aux mots dans un texte, ou détermine s'il y a un visage sur une photo avant de découvrir de quelle personne il s'agit. Lorsqu'il y a une erreur, les réponses seront éliminées et renvoyées au précédent niveau, afin d'ajuster les données. Au fur et à mesure des tests, le programme réorganise les informations jusqu'à trouver la bonne réponse. Ainsi, le modèle est par la suite en capacité d'appliquer son calcul à d'autres cas, il sera par exemple capable de repérer que l'image donnée représente un chat, sans que personne ne lui ait indiqué au départ ce qu'est un chat. Les données de départ sont ainsi essentielles, plus le système accumule de données plus il sera performant.

Exemple :

-> Reconnaissance faciale : utilisée dans des applications comme les déverrouillages de téléphone et les systèmes de sécurité tel que les caméras VSA

-> Traitement du langage naturel : utilisé dans des assistants virtuels (Siri, assistant Google...) et des traducteurs automatiques.

-> Modération automatique sur les réseaux-sociaux

-> Détection de malwares ou de fraudes bancaires

Apprentissage par renforcement

Procédé d’apprentissage automatique consistant, pour un système autonome, à apprendre les actions à réaliser, à partir d'expériences, de façon à optimiser une récompense quantitative au cours du temps. Le système est plongé au sein d'un environnement, et prend ses décisions en fonction de son état courant. En retour, l'environnement procure une récompense, qui peut être positive ou négative. Au fil des expériences, le système cherche un comportement décisionnel optimal, en ce sens qu'il maximise la somme des récompenses au cours du temps.

(source la CNIL)

Exemple :

Le logiciel MuZero de l'entreprise Britannique "DeepMind", est en capacité de maîtriser différents jeux sans en connaître les règles. La seule information qu'il a sur les jeux, c'est s'il tente un mouvement ce dernier est ou non permis, et quelles en sont les conséquences. Ainsi, il est capable de s'adapter par lui-même à son environnement et d'anticiper les règles simplement à l'aide de simulation.

Des vidéos pour mieux comprendre ce qu'est une IA

C'est quoi l'intelligence artificielle ?

Par les curionautes des sciences

C'est quoi l'intelligence artificielle ?

Par 1 jour 1 question

DES ACTIVITÉS DÉBRANCHÉES POUR COMPRENDRE LE FONCTIONNEMENT DES I.A.

Activité 1 - Animation d'un débat butiné pour mieux comprendre ce qu'est ou non l'IA

Cette technique se donne pour objectif de favoriser la réflexion collective et créative sur un sujet afin de dégager des propositions et des pistes d'action.

Déroulement :

a) L'animateur.rice divise dans un premier temps les participant.e.s en 4-5 sous-groupes de 5-6 personnes. Puis chaque sous-groupe, désigne une personne qui sera chargée de la retransmission de leurs échanges.

b) Une fois les sous-groupes constitués, l'animateur·ice lance le sujet sur lequel les participant·es sont invité·es à débattre.

Exemple :

- Entre fiction et réalité, pourquoi certains craignent l’IA ?

- L'IA est-elle dangereuse pour nos libertés individuelles ?

- L'IA fait-elle partie de notre quotidien ?

- L'IA peut-elle créer des œuvres ?

- L'IA peut-elle remplacer les humains dans certaines activités ?

- Dans quel domaine l'IA est-elle utilisée ?

- Faites-vous confiance en une IA pour écrire un texte ?

c) Durant 10 minutes, l'animateur·ice invite les sous-groupes à débattre entre eux sur la thématique de départ et à noter sur une feuille les éléments importants de leurs échanges. Ces notes serviront aux rapporteurs et rapporteuses de chacun des groupes lorsqu'ils devront par la suite retransmettre leurs échanges.

d) À la suite de ce premier temps d'échange, toutes les personnes chargées de la retransmission changent de groupe dans le sens d'une aiguille d'une montre. Le rapporteur ou la rapporteuse, qui arrive dans le nouveau groupe, dispose d'une minute pour faire la synthèse des échanges qu'il y aura eus dans le groupe précédent. Puis la discussion reprend sur les mêmes principes que le tour précédent. Chaque sous-groupe a 10 minutes pour échanger sur la question de départ mais cette fois-ci, les participant·es rebondissent sur la synthèse faite par la rapporteuse ou le rapporteur, enrichissent les idées, prolongent les réflexions... Ainsi de suite jusqu'à ce que les rappoteur·euses retrouvent leur groupe de départ. (4 tables = 4 tours)

e) À l'issue des différentes tours, chacun des rapporteur·euses fait une synthèse des échanges qui ont pu avoir lieu autour de la thématique de départ. L'animateur·ce note en parallèle les points clés qui ressortent de chaque synthèse. Il ou elle pourra s'appuyer sur les différentes réflexions des participant·es afin d'apporter des éléments clés concernant la question de départ.

Activité 2 - Comprendre l'algorithme en faisant un gâteau

Objectif : Comprendre la logique opérationnelle de l’algorithme à partir d’une recette de cuisine et identifier ses éléments essentiels (boucles, conditions, variables).

Ressource à télécharger pour l'activité du gâteau au chocolat

Atelier gâteau au chocolat

Télécharger le PDFDéroulé :

a) L'animateur·ice divise les participant·es en équipe de 5-6. Puis leur explique qu'ils et elles vont être amené·es à reconstituer une suite de données permettant à leur IA de réaliser un gâteau au chocolat.

b) Pour cela, l'animateur·ice distribue à chaque équipe des éléments qu’ils et elles devront remettre dans l'ordre afin de constituer un algorithme capable de réaliser ce gâteau au chocolat.

c) Après avoir constitué leur algorithme, les différentes équipes sont amenées à les confronter. Durant cette confrontation, les participant·es devront observer en quoi leurs algorithmes sont similaires ou différents des autres équipes.

d) Retour en grand groupe. L'animateur·ice, apporte une définition claire de ce qu'est un algorithme et les éléments essentiels à son bon fonctionnement.

" Un algorithme est une suite finie et non ambiguë d’opérations ou d'instructions permettant de résoudre une classe de problèmes, et de créer un programme informatique. On le compare souvent à une recette de cuisine. Un algorithme est donc un processus qui suit un ensemble de règles opératoires défini par son concepteur (pour reprendre l’exemple de la recette de cuisine, l'algorithme pour faire cuire des pâtes serait le suivant : mettre de l’eau dans une casserole, faire chauffer l’eau, si l’eau bout : y plonger les pâtes, si l’eau ne bout pas : ne pas mettre les pâtes dans l’eau...)." Julie Stein, 2020, Class'Code

Activité 3 - Création de ma propre IA

Dans cette activité débranchée, nous vous proposons de mieux comprendre le fonctionnement d'une IA basée sur l'apprentissage automatique appelé aussi le "Maching Learning". Pour cela les participant·es vont être amené·es à créer leur propre IA "naïve" (sans modèle) et la tester. Sur la base des résultats qu’ils et elles obtiendront, ils et elles devront améliorer leur IA jusqu'à temps que cette dernière puisse être en capacité de faire la différence entre différents animaux et/ou objets.

Objectifs :

- Comprendre ce qu’est une intelligence artificielle

- Comprendre ce qu’est le Maching Learning à travers une activité ludique et la manipulation d’objets

- Développement de l’esprit critique par l'argumentation

- S’exprimer à l’oral de façon structurée et argumentée ses choix

Déroulé :

Ressources à télécharger pour le jeu de cartes "Construit ton IA !"

cartes animaux cybersurveillance

Télécharger le PDFFiche ID Animaux - questions

Télécharger le PDFPhase 1 :

a) L'animateur·ice, imprime en amont le jeu de cartes "Construit ton IA !". Dans ce jeu de carte, plusieurs images représentent des animaux : chien, chat, éléphant, loup, chimpanzé, girafe, zèbre, panda, autruche, lion, perroquet, cheval, ours, écureuil, tigre, coccinelle, suricate, mangouste, orang-outan, panthère.

b) Après avoir imprimé les cartes, l'animateur·ice, divise le groupe en plusieurs équipes de 5-6 participante·s. Puis distribue à chaque équipe un jeu de carte "Construit ton IA! ".

c) Après avoir distribué le jeu de carte. L'animateur·ice donne les consignes suivantes aux participant.es :

"Vous avez devant vous un jeu de 20 cartes représentant des animaux. Votre objectif maintenant est de créer une IA capable de classifier et faire la différence entre ces 20 cartes. Ces dernières n'ont pas été choisies au hasard, puisqu’elles représentent des animaux ayant des caractéristiques différentes (mammifère / oiseaux) pour certains et pour d'autres similaires."

Par exemple : le long coup de la girafe et de l'autruche, le noir et blanc du panda et du zebre , les poils du chat, du chien, du loup, etc.

d) Afin de les aider dans la création de l'IA, l'animateur·ice distribue une fiche identité pour chacun des animaux. Cette dernière va permettre aux participant·es de constituer le set de données sur lequel leur IA pourra s'appuyer pour faire la différence entre les différents animaux.

Question de la fiche identité :

- L’animal a-t-il des poils ?

- L’animal a-t-il des vertèbres ?

- L'animal a-t-il 4 pattes ?

- L'animal voit-il dans le noir ?

- L'animal a-t-il un long coup ?

- L'animal est un prédateur ?

e) Après avoir rempli les fiches identités, les participant·es vont entrainer leur IA. Pour cela, l'animateur·ice désigne une personne de chaque groupe pour jouer le rôle de l'IA. Après avoir désigné les personnes, ces dernières vont devoir sortir de la salle. Puis l'animateur·ice leur donne les consignes suivantes et un dé :

- Vous ne pouvez vous exprimer qu'en posant des questions dont la réponse est "oui" ou "non".

- Vous ne comprenez que les réponses "oui" ou "non".

- Vous posez des réponses de façon aléatoire. Pour cela vous lancer le dé avant de poser votre question en appui de la fiche identité. Par exemple vous faites 6, vous devrez poser la question n°6 : "L'animal est un prédateur?"

- Vous devez à la fin de chaque partie (c'est-à-dire après avoir posé les 6 questions) fournir le nom d'un animal.

Le reste de l'équipe devient des développeurs et développeuses devant tester le fonctionnement de leur IA. Pour cela, ils et elles vont être amené·es à tirer au sort une cartes parmi les 20 présentes devant eux. La carte qu’ils et elles auront tiré au sort sera celle qu’ils et elles devront faire deviner au joueur jouant l'IA.

f) Après avoir joué plusieurs parties, les participant·es se regroupent et échangent autour de leur test :

- Est-ce que tout s’est bien passé avec l'IA ?

- L'IA a-t-elle réussi à trouver facilement l'animal ?

- Quelles ont été les difficultés selon vous ?

- Qu'est-ce qui pourrait être amélioré et permettre à votre IA de trouver la bonne réponse ?

Phase 2 :

g) Après avoir échangé autour de ce premier test, les participant·es sont amené·es à optimiser leur IA. Pour cela, l'animateur·ice, essaye de faire émerger quelques pistes pouvant être utiles pour l'amélioration de leur IA :

- Corrections des éventuelles erreurs de données dans les fiches identités des animaux.

- Créer de nouvelles questions et supprimer certaines questions

- Supprimer la règle des questions aléatoires et réfléchir à un ordre précis des questions que l'IA pourrait poser (arbre de décision).

- Permettre de poser plus de 6 questions.

- Faire attention à la pertinence des questions posées.

- Noter chaque test pour déterminer la pertinence des questions et leur ordre. (arbre de décision)

Fiche matrice - arbre de décision

Fiche matrice - arbre de décision

Télécharger le PDFh) une fois les IA améliorées, l'animateur·ice, choisit de nouveau au hasard un·e participant·e qui jouera le rôle de l'IA. Ce dernier ou cette dernière devra s'appuyer sur les nouvelles consignes mises en place par le groupe pour qu'elle puisse fonctionner et noter chaque prise de décision qu'elle fera. Cela permettra d'améliorer petit à petit l'IA jusqu'à trouver le bon fonctionnement.

Le reste des membres de l'équipe tireront au sort une des 20 cartes qu'ils et elles devront faire deviner à l'IA.

I) Après avoir joué plusieurs parties, les participant·es, reviennent en grand groupe afin d'échanger autour des différences entre la première phase de test et la deuxième. L'animate·rice, pourra poser certaines questions afin d'aiguiller les échanges avec les participant·es :

- Est-ce que tout s’est bien passé avec l'IA ?

- L'IA a-t-elle réussi à trouver facilement votre animal ?

- En combien de question l'IA a réussi à trouver votre animal ?

- Qu'avez-vous fait pour l'améliorer au fil des parties ?

- Pouvons-nous dire que l'IA a appris ?

2. Petite histoire de l'intelligence artificielle

Ce n'est qu'à partir de 1956 que le terme "Intelligence artificielle" sera utilisé par John McCarthy et Marvin Minsky à la conférence de Dartmouth au Royaume-Uni. Mais l'histoire de l'intelligence artificielle débute en 1943, lorsque Warren McCullough et Walter Pitts, publient leur article "A logical Calculus of ideas Immanent un Nervous Activity", présentant le tout premier neurone artificiel. À la suite de cela de nombreuses avancées verront le jour jusqu'au développement de l'IA que nous connaissons et utilisons dans bons nombres d’activités de notre vie quotidienne.

Histoire des sciences - L'histoire de l'intelligence artificielle

L'histoire de l'intelligence artificielle

Par L'Esprit Sorcier avec le CEA

TIME-LINE POUR DÉCOUVRIR L'HISTOIRE DE L'I.A. ET DE L'INFORMATIQUE

Objectifs :

- Découvrir les grandes dates de l'intelligence artificielle et de l'informatique

- Être en capacité de citer un événement sur une frise chronologique

- Distinguer et mettre en perspective différentes conditions (techniques, scientifiques, épistémologiques…) qui ont permis l’emergence des systèmes d’IA actuels.

Version en ligne : Placer les étiquettes sur les dates correspondantes

Version Hors ligne : Jeu de Time-line réalisation des cartes

Déroulé de l'activité :

- L'animateur.rice télécharge dans un premier temps les cartes du jeu « TIme-line de l’IA". (36 cartes recto/verso)

- L’animateur.rice compose des groupes de 4 ou 5 personnes qu’il assignera à chacune des tables de jeu. Sur chacune d’entre elles, un exemplaire du « Timeline de l’IA » est posé au milieu, en tas et coté illustration.

- La dernière personne a avoir utilisé un outil d’IA (comme ChatGPT ou Midjourney) commence. Si personne n’a jamais utilisé de type d’outil dans le groupe, alors le.la plus jeune participant.e tire la première carte et lit la description à haute voix avant de la placer au centre de la table.

- La personne à sa gauche tire la carte suivante et lit également sa description à haute voix. Elle détermine aussi si selon elle, cet évènement est antérieur ou postérieur à la première carte tirée et la place respectivement à gauche ou à droite de celle-ci. Le groupe peut échanger et confronter ses points de vus avant de poser la carte.

- La personne suivante placée à gauche tire une nouvelle carte et ainsi de suite. A chaque fois, le groupe tente collectivement de placer l’évènement sur la ligne du temps et de reconstituer cette frise historique.

- Une fois que toutes les cartes ont été placées sur la frise, le groupe les retourne et vérifie avec les dates au dos qu’elles ont été correctement placées. Il rectifie l’ordre au besoin.

- L’animateur.rice propose à l’ensemble des groupes de se rassembler pour un dernier temps d’échange collectif. Il.elle pourra prendre le temps d'apporter des éléments complémentaires concernant les inventions qui poserait problèmes ou questions auprès des jeunes. Pour cela, il.elle pourra s'appuyer sur le livret de réponse à télécharger ci-dessous.

Jeu de time-line sur l'histoire de l'IA et de l'informatique

intelligence artificielle et discriminations - jeu time line

Télécharger le PDFintelligence artificielle et discriminations - jeu time line Réponses

Télécharger le PDF3. L'IA est-elle discriminante ?

Aujourd'hui l'intelligence artificielle à permis à de nombreux secteurs d’activités de se transformer tels que : la santé, la finance, l'industrie, les sciences, la sécurité, l’éducation, etc. Plus récemment le développement de nouvelles IA permet de générer des textes des images, vidéos... grâce à des applications comme VALL-E, Midjourney, CHATGPT ou encore GEN-2.

Mais le développement rapide de ces outils, questionne et interroge de nombreuses personnes sur leur potentiel danger, notamment en ce qui concerne nos données personnelles et notre vie privée. En effet, pour s'améliorer l'IA à besoin d'accéder à un certain nombre de données. Et si aujourd'hui cette technologie se développe dans un certain nombre de secteurs, la question de l'accès à nos données personnelles se pose, tout comme l'impact sur nos libertés, droits humains, mais également les éventuels risques de manipulation de l'information et émotionnelles.

Néanmoins, l'IA n'est pas le seul danger en tant que tel, tout dépend de comment nous l'utilisons et qui l'utilise et pour en faire quoi. En effet, une IA vue comme inoffensive pourrait être détournée de son utilisation première et de façon malveillante. Nous pouvons déjà le constater avec le nombre croissant de Deepfakes aujourd'hui diffusés sur internet. En effet, la création de fausses vidéos, images créées à l'aide de l'IA et mettant en scène une personne dans une situation compromettant dans le but de lui porter atteinte sont de plus en plus fréquente. En 2019, selon l'étude mené par l'entreprise Néerlandaise Deeptrrace, 96% des Deepfake, concernent des contenus pornographiques mettant en scène dans la majorité des cas des femmes. Cela peut d'ailleurs engendrer de la désinformation lors des périodes électorales, mais aussi des attaques, moqueries, insultes en ligne à l'encontre de personnes.

L’utilisation de l'IA dans notre quotidien n'est pas si nouvelle que cela, néanmoins le recours à cette dernière par des administrations (obtention d'un prêt bancaire, d'aides sociales, diagnostics médicaux, crédit social....) entreprise privée (recrutement de salarié.e.s) , par la police (reconnaissance faciale, risque de récidive, planification des interventions par prédiction automatisée du moment et des lieux d'infractions que vont commettre les auteur.rice.s,...) ne cesse de s’accroître et se rapprochant parfois des récits de science-fiction qui nous semblaient encore loin aujourd'hui.

Récemment en France, nous avons pu en être témoins avec la mise en place des VSA lors de la loi du 19 mai 2023 relative aux jeux Olympiques et Paralympiques de 2024. Cette dernière, permettant d'expérimenter la vidéosurveillance intelligente (VSA), afin d'assurer la sécurité lors des manifestations sportives et culturelles et ce jusqu'en mars 2025 en France. Ces caméras sont ainsi capables de détecter en temps réel et ce grâce à l'Intelligence Artificielle (IA) les mouvements de foules, un sac abandonné, des comportements pouvant être considérés comme suspects aux abords des lieux accueillants du public et des transports en commun... D'autres pays avant nous, utilisait déjà la VSA tels que la Chine, le Brésile ou encore les Etats-Unis. En 2022, Amnesty International publiait son enquête sur le nombre de caméras placées dans certains quartiers de New-York. Cette enquête démontrait que le nombre de caméras de vidéo-surveillance était beaucoup plus élevé dans les quartiers non blancs de Brooklyn, de Manhattan et du Bronx. Ils en comptabilisaient près de 15 000 en 2021, utilisant toutes les technologies de la reconnaissance faciale. Tout ceci pouvant reproduire, voire amplifier des biais discriminations déjà existantes à l'encontre d'individus ou groupes d'individus au sein de nos sociétés.

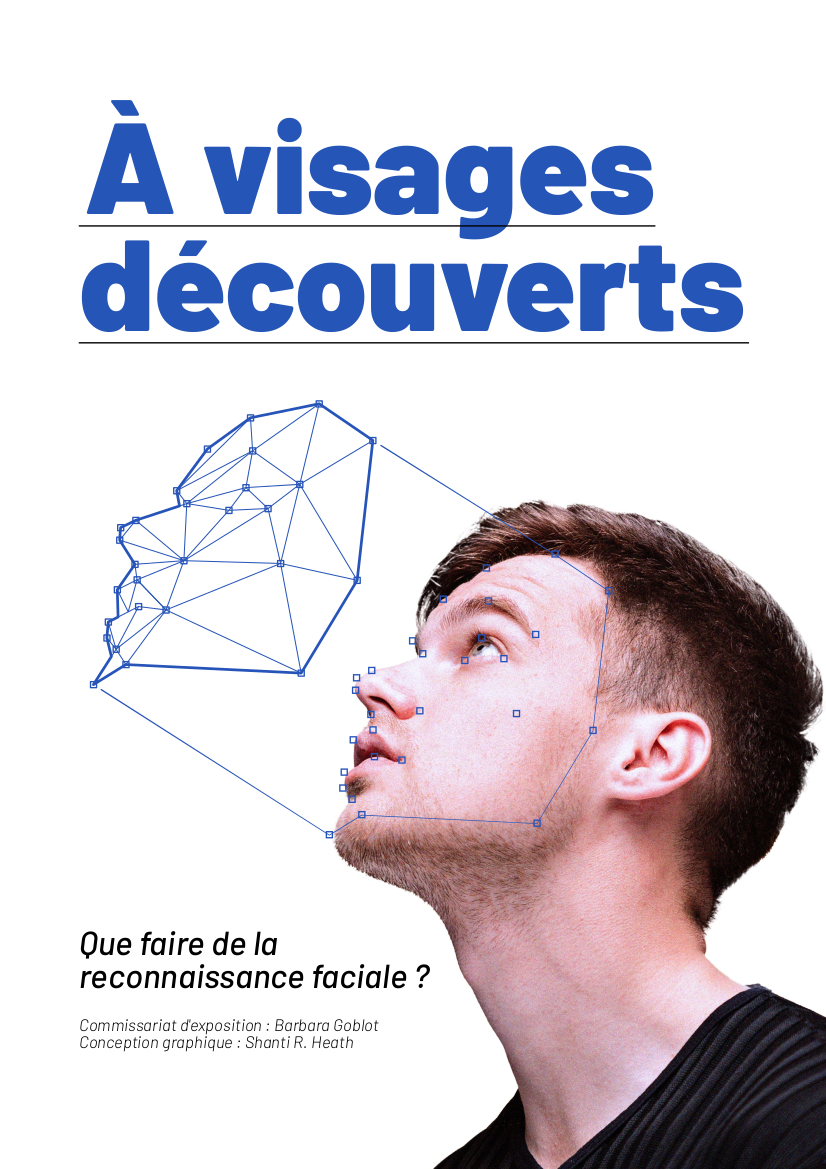

Découverte de l'exposition " À visages découverts" de Barbara Goblot :

La reconnaissance faciale c'est quoi ?

La reconnaissance faciale est un outil de biométrie physique qui emploie un système d'intelligence artificielle. Elle permet d'identifier les individus et d'analyser les visages. Ces dernières années des associations comme La Quadrature du Net s'opposent vivement à son utilisation en France.

Pour plus d'information veuillez contacter Alice Chisin ou Barbara Goblot.

L'exposition " À visages découverts" donne les clés aux visiteurs pour appréhender l'impact de la reconnaissance faciale sur notre société. Ils sont encouragés à définir leurs propres limites et à se rendre acteur des changements de société. L'exposition est narrée par Eyefinity, une entreprise fictive de reconnaissance faciale. Eyefinity nous présente les bienfaits de sa technologie, sur le ton enjoué d'une publicité. Le discours s'articule entre des images, des slogans et un dispositif audio, accessible par QR codes (durée : 12 minutes). Les usages proposés par l'entreprise sont de plus en plus intrusifs et dystopiques, mais pour autant ils existent bel est bien en France ou ailleurs dans le monde.

Mais quel danger, quand l'utilisation d'une IA se substitue à une administration, un policier, un juge ou un magistrat et entraîne de la discrimination ?

Ces 10 dernières années, de nombreux exemples ont pu illustrer les limites de l'utilisation de l'IA dans certaines prises de décision et ce dans le monde entier :

En Espagne : Alors qu'Itziar Prats, venait porter plainte contre son ex-mari suite à des menaces de morts proférées à l'encontre de ses filles le 14 février 2018. L'agent qui prendra sa plainte, utilisera une IA, "VioGen" permettant de "calculer le risque de récidive dans la violence sexiste". Après avoir donné le nom, prénom et la profession de son ex-mari, l'IA calculera que le risque de violence est "faible". Sept mois plus tard l'ex-mari tuera ses deux filles et se suicidera.

Aux Pays-Bas : En 2010, l'administration des Pays-Bas, utilisera une IA afin de détecter les fraudeurs aux aides sociales. Cependant cette dernière, défaillante, jugera dans sa base de données la nationalité étrangère ou un bas revenu comme étant des facteurs risque importants. Des profils de personnes immigrées ou pauvres étaient automatiquement considérés comme fraudeurs. Les Pays-Bas ne sont pas les seuls puisqu'en France, la CAF (Caisse des allocations familiales) utilise une IA permettant de traquer les fraudeurs et fraudeuses. La Quadrature du Net, a récemment révélé le fonctionnement de cette IA, et démontré que cette dernière ciblait les personnes les plus précaires comme étant des personnes ayant un risque élevé de fraude. Ainsi, l'IA calcule un score de suspicion de fraude élevée lorsque la personne est au RSA, élève seule un enfant, est d'origine étrangère, est en situation de handicap....

Aux Etats-Unis : En 2016, des juges se sont appuyés sur l'IA "COMPAS", permettant de calculer le risque qu'un prisonnier puisse commettre de nouveaux délits. Mais les travaux des journalistes Angwin et al, de ProPublica en 2016, ont démontré dans un rapport que cette IA prédictive avait été mal programmée par la société Northpointe. Ainsi, les prisonniers noirs étaient deux fois plus accusés de récidive en comparaison des prisonniers blancs. Engendrant des prises de décisions erronées de la part des juges, qui avaient tendance à suivre l'IA et refuser les libérations conditionnelles des prisonniers noirs.

En Chine: Dans les villes de Pékin et Handzhou, un robot en hologramme a été programmé, afin de remplacer les magistrats et régler en ligne des litiges civils 24 heures sur 24. Cette IA enregistre les preuves, interroge les plaignant·es et rédige les jugements.

Ces exemples, peuvent nous amener à nous poser la question suivante : faut-il nous en remettre aux IA pour toutes les situations au risque que ces dernières commettent des erreurs et notamment de la discrimination ?

Si ces algorithmes peuvent engendrer de la discrimination, ce n'est pas si anodin que cela. En effet, les IA, sont remplies de biais, que nous nommons "biais algorithmiques", reproduisant des stéréotypes et préjugés déjà bien ancrés dans nos sociétés. Ainsi, leur utilisation par des services judiciaires, la police, les banques ou par les services publics peut entraîner et ne faire qu'ancrer ces stéréotypes liés à certains groupes minoritaires dans l'imaginaire collectif.

Pour aller plus loin :

Trois webinaires pour échanger autour de la citoyenneté numérique à l'ère de l'IA

Webinaire - "L'IA : miroir de nos sociétés ?"

Webinaire "L'IA : un danger pour les droits humains ?"

Webinaire "L'IA : quel impact sur l'environnement ?"

Les biais qui animent les IA

Les biais qui animent les IA sont nombreux. En effet, les intelligences artificielles sont créées par des personnes elles-mêmes remplies de biais pouvant ainsi engendrer des discriminations. Les chercheurs Andrew D. Selbst et Solon Barocas, expliquent que si les données d'apprentissage sont biaisées cela va ainsi produire des effets discriminatoires. En effet, si ces dernières s'appuient sur une base de données, mais que celle-ci est incomplète ou peu représentative de la société, alors on crée des biais engendrant de la discrimination. En 2015, Google images, dont l'algorithme a été entrainé à partir d'une base de données incomplète, avait tendance à identifier les personnes noires avec des singes. Au Royaume-Uni, en 1980, une école de médecine à mis en place un logiciel permettant de trier les candidatures beaucoup trop nombreuses à l'époque. Les données d'apprentissage de ce logiciel étaient constituées de données en lien avec les dossiers d'admission des candidats des années précédentes, qui étaient sélectionnés par des humains. En s'appuyant sur les données des années précédentes, le logiciel de tri avait tendance à rendre un avis défavorable concernant les candidatures des femmes et des personnes issues de la migration. Ainsi, il semblerait que la base de données d'apprentissage sur laquelle s’est appuyé le logiciel, était remplie de préjugés envers les femmes et les personnes issues de la migration.

Véritable miroir de nos sociétés, les IA sont des programmes conçus en majorité par des hommes blancs (70% contre 30% des femmes selon le rapport publié en 2023 par le World Economic Forum), engendrant une vision biaisée de nos sociétés. En 2024, l'UNESCO, dévoile dans son étude "Remettre en question les préjugés systématiques : une enquête sur les préjugés contre les femmes et les filles dans les grands modèles linguistiques", que les IA Llama 2 de META et GPT-2 d'OPEN AI, ont tendance à attribuer aux hommes des emplois à statut élevé (ingénieur, médecin ou enseignant) et décrivent les femmes comme des "travailleuses domestiques". De plus, lorsqu'il demande d'écrire une histoire sur des personnes de genre, sexualité et milieux culturels différents, les IA n'utiliseront pas les mêmes termes pour parler des Femmes/Filles ou des Hommes/Garçons. Les histoires concernant des garçons et des hommes générées par l'IA seront dominées par les termes « trésor », « bois », « mer », « aventureux », « décidé » et « trouvé », tandis que les histoires concernant les femmes et les filles utilisent plus fréquemment les mots « jardin », « amour », « ressenti », « doux », « cheveux » et « époux ».

COMPRENDRE LE FONCTIONNEMENT DES BIAIS COGNITIFS

Activité 1 - Les biais cognitifs : Jeu de cartes par Laurence Vagner et Stéphanie Walter

a) L'animateur.rice distribue au groupe un jeu de 52 cartes représentant des biais cognitifs. En fonction de la thématique traité, il.elle pourra sélectionner les biais en amont de la séance.

b) Après avoir donné les cartes. L'animateur.rice, demande au groupe d'analyser et regarder les cartes placées devant eux. Il.elle leur explique que les cartes représentent différents biais cognitifs et sont classés en 5 catégories :

- Prise de décision et comportement

- Raisonnement et résolution de problème

- Mémoire et souvenirs *

- Interview et test utilisateur

- Travail d’équipe et réunion.

Ces dernières permettent de prendre conscience de nos biais et leurs conséquences, intentionnels ou inconsciente sur les individus.

c) Après avoir pris connaissances des différentes cartes. Le groupe devra sélectionner 5 cartes parmi celles posées devant eux. Dans un second temps, ils.elles seront amenées à présenter les 5 biais sur une feuille de paperboard (cela peut prendre la forme que vous voulez : schéma, dessin, texte, nuage de mots…).

d) Enfin, après avoir présenté les 5 biais, l'animateur.rice demandera au groupe de donner un exemple ou plusieurs où ces biais pourraient prendre place, ainsi que leurs conséquences discriminatoires sur les individus.

Cartes biais cognitifs

cartes biais cognitifs

Télécharger le PDF

DEUX ACTIVITÉS POUR DÉCONSTRUIRE LES STÉRÉOTYPES DE GENRE EN UTILISANT L'I.A.

Dans cette activité, les participant.es seront amenés à :

• Appréhender les notions de stéréotype, préjugé et discrimination.

• Comprendre le fonctionnement d'une IA générative

• Comprendre la notion de biais algorithmique

Activité 1 : IA et sexisme - Utilisation d'un générateur d'images

Déroulement :

a) L'animateur.rice, réparti les participant·es en îlots de 4 à 6 personnes

Puis donne les consignes suivantes :

- Au sein des îlots les participant·es forment des binômes ou trinômes et utilisent un ordinateur.

- Les participant·es se rendent sur le site https://www.craiyon.com/ et vont générer des images avec l’IA. Il faut préciser que l’activité doit être réalisé en anglais pour que l’IA comprenne au mieux le Prompt.

- Pour guider l’activité les groupes vont recevoir une feuille de route comprenant des mots à tester auxquels les participant.es pourront ajouter des adjectifs ou des compléments (toujours en anglais)

- Avant de générer une image les participant·es renseignent une description des résultats qu’ils s’attendent à observer en fonction du prompt.

- Après avoir généré une image les participant·es comparent les images avec leurs résultats attendus et note leurs observations et leurs analyses.

b) L’animateur·rice distribue les « feuille de route » et laisse les participant·es en autonomie générer des images en suivants les instructions de la feuille.

Il·elle reste disponible pour répondre aux interrogations. 10 Minutes.

c) Les participant·es mutualisent au sein de leurs îlots les images générés et les observations qu’ils·elles ont fait. 5 Minutes.

d) L’animateur·rices projette au tableau des images générées par craiyon et demande à l’ensemble des participant·es quel pourrait être le prompt utilisé pour générer cette image. 5 Minutes.

e) Pour conclure ce temps, l’animateur·rice en appuie des dernière images essayera avec les participant.e.s de répondre à la question suivante : “Les IA sont-elles vectrices de stéréotypes discriminants?”

Grille d'analyse I.A. et sexisme

Grille d'analyse I.A.et sexisme

Télécharger le PDFActivité 2 : Déconstruire les contes de fées à la façon des "Contes à rebours" de Typhaine D

Déroulement :

a) L'animateur.rice demande aux participant.es de choisir un personnage féminin, issue d'un conte, d'un mythe ou d'une légende. Par exemple : Cendrillon, Blanche-Neige, la belle au bois dormant, Shéhérazade, Peau d’âne, Belle (de La Belle et la Bête), la petite Sirène, la petite Fille aux Allumettes, la Reine des Neiges, Pénélope, Aphrodite, Hélène de Troie, Ariane, Méduse, Guenièvre, Iseult, Isis, une héroïne de manga, etc.

b) Puis rendez-vous sur Talk Ai ou une autre IA générative, et demandé lui de vous raconter l'histoire de votre personnage à la 1ère personne.

c) Après que l'IA ai généré le texte, copier/coller le dans un fichier de traitement de texte. Puis donner des extraits de l'œuvre aux participant.es pour qu'ils.elles puissent comparer le texte original et celui produit par l'IA.

d) Après avoir comparé les deux histoires, les participant.es seront amenés à réécrire le texte généré par l'IA en faisant en sorte de déconstruire les discours genrés qui y sont présent.

e) Enfin, après avoir finalisé leur texte ils.elles pourront générer une image représentant leur personnage féminin et la présenter à l’ensemble du groupe.

4. L’AI ACT, première réglementation autour de l'IA

Alors que l'intelligence artificielle, fait partie de notre environnement quotidien (débat entre ami·ies, dans les repas de famille, à l'école, dans les médias...), il faudra attendre mai 2024 pour que la toute première loi soit mise en place afin de réguler les dérives possibles engendré par celle-ci. Cette loi, c'est l'AI ACT. Elle est adoptée par le Conseil de l'Europe, le 17 mai 2024, et vise à garantir une IA plus respectueuse des droits fondamentaux. Elle vise également à harmoniser les règles relatives à l'IA et propose que des systèmes d'IA pouvant être utilisés dans différentes applications, soient analysés et classés en fonction du risque qu'elles peuvent représenter pour la santé, la sécurité ou les droits fondamentaux de leurs utilsateur.rices. En fonction du niveau de risque évalué par la réglementation, la sanction encourue par l'entreprise sera différente.

L'AI ACT, classe les risque en quatre niveaux

- Risque inacceptable : Interdit un ensemble limité de pratiques contraires aux valeurs de l'Union européenne et aux droits fondamentaux.

Exemples : la notation sociale, l’exploitation de la vulnérabilité des personnes, le recours à des techniques subliminales, l’utilisation par les services répressifs de l'identification biométrique à distance en temps réel dans des espaces accessibles au public, la police prédictive ciblant les individus, reconnaissance des émotions sur le lieu de travail et dans les établissements d'enseignement.

- Haut risque : les systèmes d'IA sont considérés à haut risque lorsqu’ils peuvent porter atteinte à la sécurité des personnes ou à leurs droits fondamentaux ce qui justifie que leur développement soit soumis à des exigences renforcées (évaluations de conformité, documentation technique mécanismes de gestion des risques).

Exemples : systèmes biométriques, des systèmes utilisés dans le recrutement, ou pour des usages répressifs.

- Risque spécifique en matière de transparence : le RIA soumet des systèmes d'IA à des obligations de transparence spécifiques, notamment en cas de risque manifeste de manipulation.

Exemples : recours à des chatbots ou à la génération de contenu artificiel.

- Risque minimal : pour tous les autres systèmes d'IA, le RIA ne prévoit pas d’obligation spécifique. Il s’agit de la très grande majorité des systèmes d’IA actuellement utilisés dans l'UE ou susceptibles de l'être selon la Commission européenne.